Ya es un hecho: la inteligencia artificial (IA) marcará el futuro del planeta y del ser humano. Casi nadie pone en discusión esta evidencia. El consenso sobre el qué, sin embargo, no evita el debate acerca del cómo. En concreto, acerca de la velocidad en la que la IA debe seguir avanzando.

Una discusión en la que se han zambullido, de lleno, los grandes nombres del sector tecnológico y del mundo business. Hace un par se semanas, un grupo de empresarios relacionados con el universo tech publicó una carta en la que pedía un tiempo muerto de seis meses para establecer marcos legales y de seguridad claros y compartidos, antes de continuar desarrollando los sistemas de IA más avanzados.

Accede a las historias más relevantes de negocios, bienestar y tecnología. Entérate de nuestros rankings y eventos exclusivos. Suscríbete y recibe en tu correo el mejor contenido de Mercado.

La misiva, publicada por la organización sin ánimo de lucro Future of Life, tenía un tono apocalíptico y contaba con ilustres firmantes entre las 25 mil personas que ya se han adherido. Entre ellos, dos muy destacados: el fundador de Apple, Steve Wozniak, y Elon Musk.

El documento parecía apuntar veladamente a OpenAI, compañía fundada entre otros por Musk, y a la posibilidad de que el desarrollo de GPT-5 estuviese avanzando a demasiada velocidad, poniendo en grave riesgo a la sociedad y la humanidad.

La respuesta de su CEO, Sam Altman, llegó apenas unos días más tarde, durante un evento del Instituto de Tecnología de Massachusetts (MIT) en el que participó pro videoconferencia. Y tuvo algunos aspectos llamativos.

Según recoge la agencia de noticias EFE, el emprendedor calificó la misiva de «ridícula», lamentando que al manifiesto «le faltaban la mayoría de los matices técnicos sobre dónde necesitamos la pausa».

Sin embargo, Altman sí parece compartir la preocupación y, por ello, se ha sumado al paréntesis, aunque afirmó que ya lo había hecho antes de la publicación de la carta firmada por Musk o Wozniak. De hecho, aseguró que no están desarrollando GPT-5 y no lo harán «por algún tiempo».

Para profundizar: GPT-4. Estas son las novedades de la actualización del chat de Inteligencia Artificial

Además, declaró que son conscientes de que deben «moverse con precaución», con un «rigor cada vez mayor en cuestiones de seguridad. También estoy de acuerdo en que, a medida que las capacidades se vuelven más y más serias, el listón de seguridad debe aumentar«.

Una corriente a la que se une el CEO de Alphabet (matriz de Google), Sundar Pichai. El alto ejecutivo se declaró preocupado por el camino que está tomando la IA, y advirtió que si se desarrolla de forma incorrecta puede ser «muy perjudicial» para la humanidad.

En palabras a la CBS, llegó a reconocer que el chatbot creado por su compañía, Google Bard, le dejó «sin palabras» y admitió que no entiende del todo cómo funciona. Así, piensa que la sociedad todavía «no está preparada» para asumir las consecuencias de todos estos avances.

Por eso, y pese a no sumare explícitamente a la carta de Future of Life, pidió a los estamentos públicos que trabajen en un marco legal y en protocolos de seguridad sólidos y claros.

«Creo que debemos abordar esto con humildad«, apuntó. «Es positivo que algunas de estas tecnologías vean la luz para que la sociedad procese lo que está sucediendo, y así comenzar un debate». Sin embargo, considera que la velocidad está siendo excesiva, también para los gobiernos. «Hay un desajuste entre el ritmo en que evoluciona la tecnología y el de las instituciones».

No duda, eso sí, de que la IA será la próxima gran revolución. «Considero la inteligencia artificial como una tecnología más profunda que el fuego, o la electricidad, o cualquiera que hayamos visto en el pasado».

Frente a esta corriente, una voz de peso se ha levantado radicalmente en contra de la carta. Es la del exCEO de Google, Eric Schmidt. El empresario e informático estaodunidense, que llevó las riendas de la big tech durante una década (2001-2011), considera que parar durante seis meses tendría una efecto concreto muy nocivo: daría una enorme ventaja a China.

En declaraciones a The Australian Financial Review, el ejecutivo se muestra comprensivo con las preocupaciones relativas a la velocidad de los avances, pero cree que la solución no está en activar el Pause. Aboga, en cambio, por que las empresas tecnológicas «se sienten cuanto antes a decidir cuáles son los guardarraíles adecuados».

De lo contrario… «China es muy inteligente. Necesitamos actuar de forma coordinada».

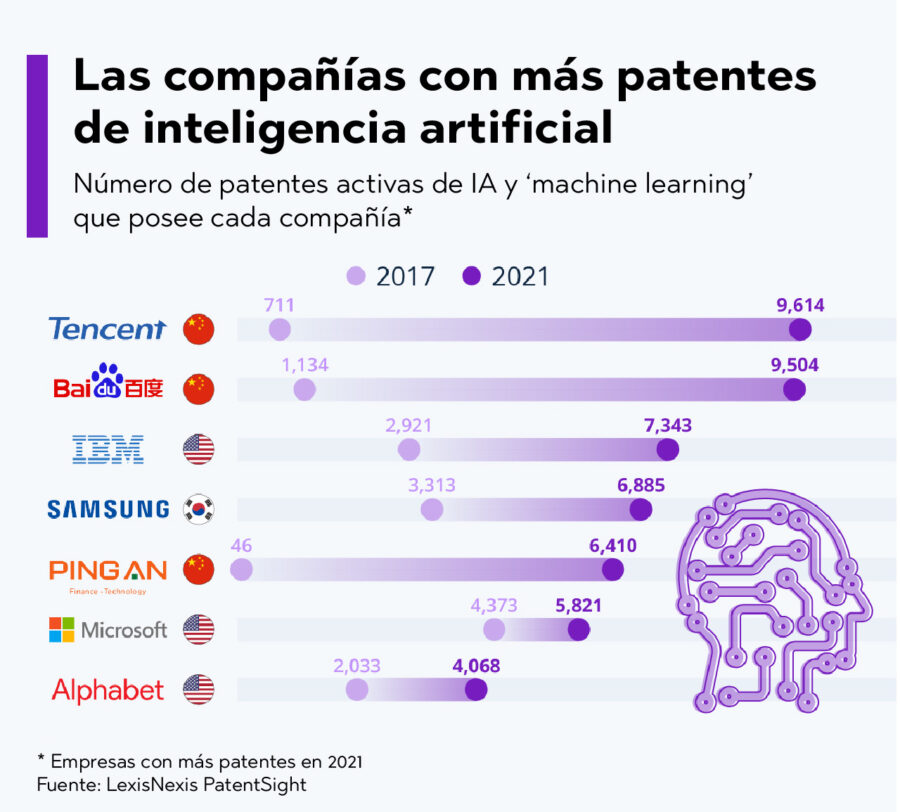

Algunos datos demuestran la fortaleza con la que China está apostando por la inteligencia artificial. Destaca, por ejemplo, el enorme crecimiento del número de patentes en IA y machine learning que desarrollan sus principales empresas.

En 2021, tres de las siete compañías del mundo con más patentes en la materia, incluidas las dos primeras (Tencent y Baidu), eran chinas. Otras tres eran estadounidenses. El crecimiento del tridente asiático había sido de cais un 1,250 % en su número de patentes desarrolladas, por un 108 % en el caso de las de EE.UU.

Schmidt teme que, si las empresas estadounidenses aceptan el parón, China gane una ventaja irrecuperable. Del otro lado, la preocupación se enfoca en los riesgos de un exceso de velocidad. Lo que parece claro es que nadie sabe, a ciencia cierta, a dónde nos lleva esta nueva aventura. ¿Convendría consultarlo con un bot?

Borja Santamaría

La era de la inteligencia artificial. Esto opina Bill Gates

Suscríbete a la revista y regístrate a nuestros newsletters para recibir el mejor contenido en tu buzón de entrada.

Con la compra de tu suscripción digital, recibes acceso a contenido premium dentro de nuestra plataforma web.

Acceso exclusivo a noticias, entrevistas y artículos

Acceso prioritario a eventos

Newsletters digitales diarios

RD$ 16,800

-15% DE AHORRO

RESPECTO A ANUAL

Facturado Cada Dos Años

298 / Mes

Acceso exclusivo a noticias, entrevistas y artículos

Acceso prioritario a eventos

Newsletters digitales diarios

Newsletters especiales y especializados

12 ediciones digitales de Mercado

12 ediciones digitales de Market Brief

Nuevas ediciones al instante en tu correo

RD$ 33,600

-15% DE AHORRO

RESPECTO A ANUAL

Facturado Cada Dos Años

595 / Mes

Acceso exclusivo a noticias, entrevistas y artículos

Acceso prioritario a eventos

Newsletters digitales diarios

Newsletters especiales y especializados

12 ediciones digitales de Mercado + 5 ediciones especiales

6 ediciones digitales de Mercado Región Norte

4 ediciones digitales de Mercado Región Este

12 ediciones digitales de Market Brief

12 ediciones digitales de ¡HOLA! RD + 5 ediciones especiales

6 ediciones digitales de MediHealth

5 ediciones digitales de Technology

Nuevas ediciones al instante en tu correo